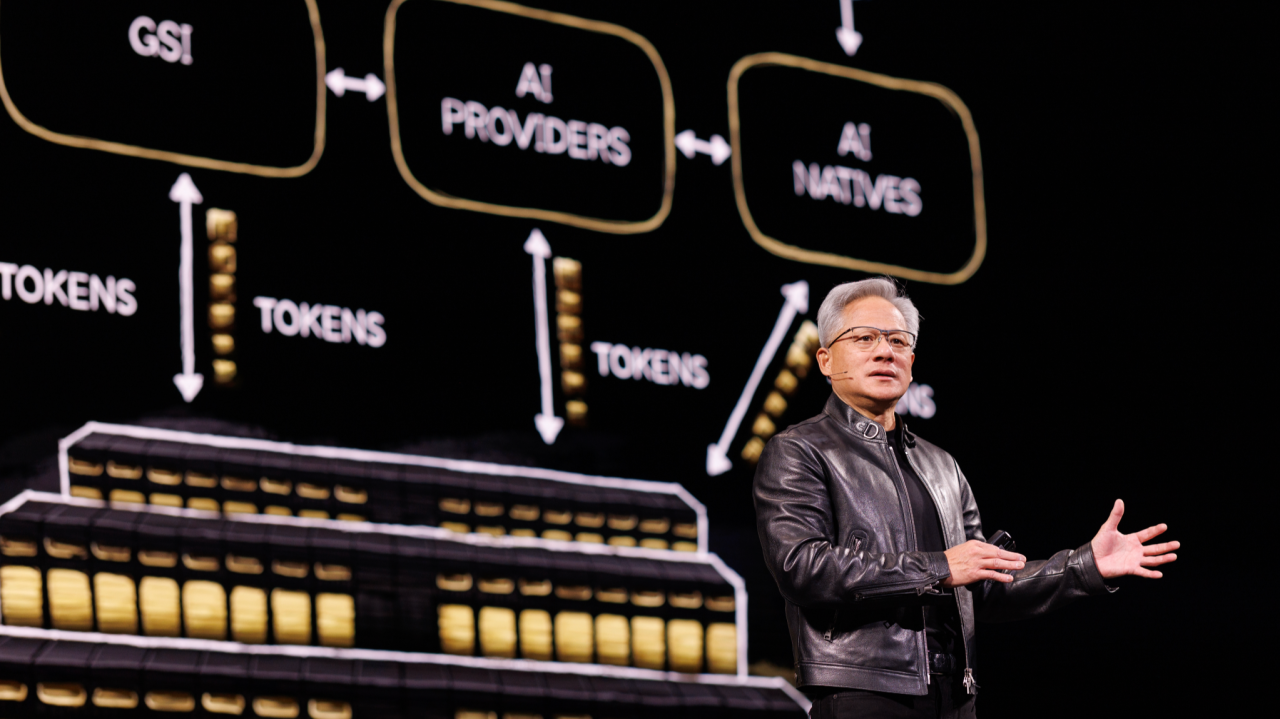

Tại sự kiện NVIDIA GTC 2026, AWS và NVIDIA đã công bố bước tiến mới trong quan hệ hợp tác 15 năm, tập trung vào việc cung cấp hạ tầng AI toàn diện từ phần cứng, kết nối mạng đến các dịch vụ quản trị thông minh.

Trong kỷ nguyên Trí tuệ nhân tạo (AI) đang phát triển với tốc độ chóng mặt, thách thức lớn nhất của doanh nghiệp không còn nằm ở việc “thử nghiệm” mà là làm thế nào để vận hành AI trong môi trường sản xuất. Để tạo ra kết quả kinh doanh thực thụ, hệ thống AI cần sự tin cậy, hiệu suất cao ở quy mô lớn, đồng thời tuân thủ nghiêm ngặt các tiêu chuẩn bảo mật.

Mở rộng hạ tầng AI: Cuộc chạy đua của những con số ấn tượng

Để đáp ứng nhu cầu tính toán khổng lồ cho các mô hình ngôn ngữ lớn (LLM) và tác nhân AI, AWS cam kết một lộ trình hạ tầng mạnh mẽ:

Hơn 1 triệu GPU NVIDIA mới: Bắt đầu từ năm 2026, AWS sẽ triển khai hơn 1 triệu GPU dựa trên kiến trúc Blackwell và Rubin trên khắp các vùng (Region) toàn cầu.

Tiên phong hỗ trợ Blackwell Server: Amazon EC2 sẽ là dịch vụ đám mây đầu tiên hỗ trợ GPU NVIDIA RTX PRO 4500 (Blackwell Server Edition), tối ưu cho phân tích dữ liệu, AI hội thoại và kết xuất video chuyên nghiệp.

Sức mạnh từ AWS Nitro System: Các instance mới được xây dựng trên hệ thống Nitro giúp tối ưu hóa hiệu suất phần cứng và bảo mật tuyệt đối dữ liệu nhạy cảm trước mọi truy cập trái phép.

Agentic AI: Khi AI không chỉ suy nghĩ mà còn hành động

Điểm nhấn tại GTC 2026 chính là khả năng hỗ trợ Agentic AI, những hệ thống có khả năng tự chủ lập kế hoạch và thực thi quy trình công việc phức tạp.

Hạ tầng tối ưu: Với bộ sưu tập GPU rộng nhất trên thị trường, AWS cung cấp nền tảng vững chắc để doanh nghiệp xây dựng các đặc vụ AI có khả năng suy luận và tương tác theo thời gian thực.

NVIDIA NIXL trên AWS EFA: Giải pháp này giúp loại bỏ “nút thắt cổ chai” trong giao tiếp giữa các chip xử lý, giảm thiểu độ trễ giao tiếp và tối đa hóa hiệu suất khi suy luận các mô hình LLM phân tán.

Tăng tốc xử lý dữ liệu: Nhanh hơn gấp 3 lần với GPU NVIDIA

Xử lý dữ liệu thô luôn là giai đoạn tốn thời gian nhất trong vòng đời AI/ML. AWS và NVIDIA đã hiện thực hóa một bước nhảy vọt về hiệu suất:

Amazon EMR trên EKS: Kết hợp với instance Amazon EC2 G7e (sử dụng GPU RTX PRO 6000 Blackwell), các tác vụ Apache Spark giờ đây chạy nhanh hơn gấp 3 lần.

Lợi ích: Kỹ sư dữ liệu có thể cắt giảm thời gian chạy phân tích từ hàng giờ xuống còn hàng phút mà không cần thay đổi mã nguồn ứng dụng hiện có.

Amazon Bedrock: “Sân chơi” mới cho mô hình NVIDIA Nemotron

Dịch vụ quản trị AI hàng đầu của AWS – Amazon Bedrock – sẽ sớm đón nhận những cập nhật quan trọng cho dòng mô hình Nemotron:

Reinforcement Fine-Tuning (RFT): Cho phép tinh chỉnh mô hình Nemotron theo đặc thù của ngành (Y tế, Tài chính, Luật) mà không cần quản lý hạ tầng.

Nemotron 3 Super: Mô hình hỗn hợp (Mixture of Experts – MoE) chuyên dụng cho các hệ thống đa đặc vụ (multi-agent), giúp duy trì độ chính xác trong các quy trình đa bước phức tạp.

Hiệu quả năng lượng: Lợi thế cạnh tranh bền vững

Trong kỷ nguyên AI, hiệu suất trên mỗi watt điện chính là thước đo của sự tối ưu. Hạ tầng AWS được thiết kế để tiết kiệm năng lượng gấp 4,1 lần so với các trung tâm dữ liệu tại chỗ (on-premises), giúp doanh nghiệp vừa đạt mục tiêu ESG, vừa giảm chi phí vận hành dài hạn.

Kết luận

Sự kết hợp giữa AWS và NVIDIA không chỉ là việc lắp ghép các tính năng đơn lẻ, mà còn là việc xây dựng một AI full-stack hoàn chỉnh. Từ lớp vật lý GPU đến mạng lưới và dịch vụ quản trị, mọi mảnh ghép đều được tối ưu hóa để đưa ý tưởng AI của bạn vào thực tế sản xuất nhanh nhất.

Bạn đã sẵn sàng đưa AI từ thử nghiệm vào thực tế sản xuất? Đừng để doanh nghiệp tụt lại phía sau trong cuộc đua công nghệ 2026. Hãy để các chuyên gia tại OSAM đồng hành cùng bạn hiện thực hóa sức mạnh từ hạ tầng AWS & NVIDIA.

Follow OSAM ngay để cập nhật các thông tin công nghệ mới từ AWS!